Tại Reboot Development Blue 2024, Micaela Hayes của Unity đã xuất hiện trên sân khấu để giải quyết chủ đề về độc tính trực tuyến, cách chống lại nó và tầm quan trọng của việc đối đầu với nó không chỉ từ quan điểm đạo đức mà nói thẳng ra là như một quyết định kinh doanh.

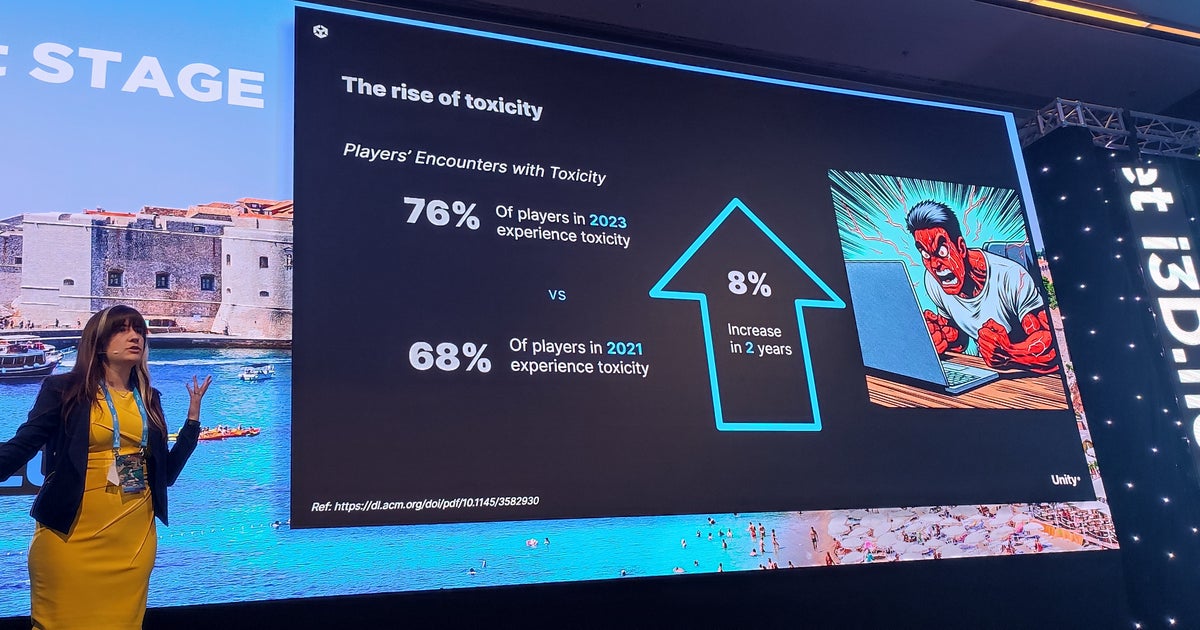

Cô giải thích, từ năm 2021 đến năm 2023, số người gặp phải một số dạng ngộ độc đã tăng từ 68% lên 76% và khoảng 49% người chơi cho biết họ tránh các trò chơi cụ thể vì lý do này. Cuối ngày, khi chúng tôi có cơ hội phỏng vấn cô ấy về những chủ đề này, chúng tôi đã hỏi cô ấy tại sao cô ấy nghĩ con số này đang tăng lên.

Cô nói: “Tôi nghĩ mọi chuyện trở nên tồi tệ hơn vì trong thời gian diễn ra dịch bệnh COVID và năm 2020, rất nhiều người đã vào trong nhà để chơi game. Cộng đồng trò chơi đã phát triển và chúng tôi gần như chững lại kể từ đó, vì nhiều người đã quay lại trường học.” , trở lại làm việc. Họ không ở nhà nhiều nữa.”

Việc khóa máy rõ ràng có tác động rất lớn đến sức khỏe tâm thần và Hayes cho rằng “sự đồng cảm của mọi người đã thay đổi”, cho thấy người chơi trở nên tập trung hơn vào bản thân và không có trải nghiệm giống như tương tác trực tiếp. Điều đó đặc biệt phù hợp với những người trẻ tuổi, những sinh viên đã bỏ lỡ hai hoặc ba năm tương tác với con người trong giai đoạn phát triển cảm xúc rất mong manh của họ.

Hayes giải thích: “Nó làm ô nhiễm môi trường của con người rất nhiều và lấy đi tính nhân văn của nó”. “Và tôi nghĩ điều đó có tác dụng ở mọi khía cạnh của thế giới, đặc biệt là chơi game. Đặc biệt vì bạn đang ẩn sau màn hình máy tính. Bạn không có máy ảnh. Không có thông tin nhận dạng nào đến từ hồ sơ của bạn hay bất cứ thứ gì. Vì vậy, mọi người cảm thấy an toàn.” trong đó.”

“Kiểm duyệt chứng kiến một trong những doanh thu cao nhất trong ngành vì họ phải đối mặt với ngôn ngữ tục tĩu và những mối đe dọa khủng khiếp hàng ngày. Tâm lý con người chỉ có thể chịu đựng đến mức đó trước khi hỏi liệu điều đó có xứng đáng hay không”

Dữ liệu cũng cho thấy hành vi độc hại không nhất thiết phải đến từ một nhóm nhỏ những người tức giận. Hayes nói: “Có sự gia tăng độc tính nói chung.

Nhưng tình hình hiện tại có thể bắt nguồn từ xa hơn nhiều so với năm 2020; Hayes cho rằng văn hóa chống độc tính trong thời kỳ đầu của Noughties có thể là một phần của vấn đề.

Cô nói: “Khi tôi bắt đầu chơi game, không có phong trào chống chất độc nào cả. “Loại hành vi đó chỉ là một phần của văn hóa, một phần của trải nghiệm, đối phó với nó hay bỏ đi.

“Sự hiểu biết nền tảng của bạn về trò chơi điện tử xuất phát từ khi bạn bắt đầu lần đầu tiên. Và tôi nghĩ rằng khi bạn bắt đầu cuộc phiêu lưu chơi trò chơi của mình trong một môi trường độc hại như thế và bạn nghĩ rằng điều đó đã được bình thường hóa thì bạn sẽ mong đợi nó tiếp tục như vậy, bởi vì Thật không may, đó chỉ là một phần của trải nghiệm.”

Cô nói thêm rằng việc thay đổi mô hình hành vi trực tuyến không phải là điều dễ dàng: “Nó đã được bình thường hóa từ lâu, mọi người chỉ nghĩ đó là một phần cách thức hoạt động của trò chơi. Rất may, ngày càng có nhiều công ty hiểu rằng điều đó không chỉ quan trọng mà còn trách nhiệm của họ là phải làm điều gì đó về môi trường mà họ tạo ra cho người chơi của mình.”

Trong buổi nói chuyện của mình, Hayes đã chỉ ra điểm tích cực cho những số liệu thống kê khủng khiếp mà chúng tôi đã đề cập trước đó: các nghiên cứu cho thấy khoảng 96% mọi người muốn làm điều gì đó để giải quyết vấn đề này. Ngoài ra, nhiều người nói rằng họ sẵn sàng trả thậm chí gấp đôi giá hàng tháng cho một trò chơi nếu điều đó có nghĩa là môi trường trò chơi không độc hại.

Nhưng những gì có thể được thực hiện và các công ty đã thực sự cố gắng giải quyết tình huống này như thế nào? Hayes đã tóm tắt ngắn gọn vấn đề này trong buổi nói chuyện của mình, giải thích tại sao hầu như luôn có sự thỏa hiệp trong đó. Ví dụ: việc kiểm duyệt dựa trên báo cáo rất phức tạp vì nó thường không dựa trên bằng chứng, nó phụ thuộc vào ý chí hành động và báo cáo của mọi người và hiếm khi tạo ra bất kỳ phản hồi trực tiếp nào cho người dùng. Sử dụng diễn đàn hoặc Discord có nghĩa là người chơi phải rời khỏi trò chơi để báo cáo. Bản chép lại lời nói thành văn bản bỏ qua các sắc thái, giọng điệu, văn hóa cộng đồng, đây cũng có thể là vấn đề với việc kiểm duyệt thuê ngoài.

“Ngày càng có nhiều công ty hiểu rằng họ có trách nhiệm phải làm gì đó với môi trường mà họ tạo ra cho người chơi”

Và một trong những vấn đề lớn nhất là việc đánh giá hành vi theo ngữ cảnh khó đến mức nào: một kiểu nói đùa nhất định có thể là xúc phạm giữa những người hoàn toàn xa lạ và hoàn toàn bình thường giữa bạn bè, hoặc thường được chấp nhận trong game bắn súng góc nhìn thứ nhất và cực kỳ không thể chấp nhận được trong một trò chơi dành cho những đứa trẻ con.

Vậy ngành này giải quyết các vấn đề phức tạp này như thế nào? Cách tiếp cận của Haye có thể bắt nguồn từ nền tảng giảng dạy của cô ấy; trước đây cô ấy từng là giáo viên toán trung học, trước đây

cô đã có cơ hội biến niềm yêu thích chơi game của mình thành công việc bằng cách trở thành quản lý cộng đồng tại Hi-Rez Studios.

“Tôi đã làm việc ở đó khoảng năm hoặc sáu năm, nhưng trong thời gian đó tôi đã chuyển từ quản lý cộng đồng sang lĩnh vực phát triển kinh doanh.”

Sau khi chuyên về an toàn cộng đồng và chống độc tính, cô bắt đầu làm việc trên dịch vụ trò chuyện và thoại Vivox trong Unity, tập trung vào hệ thống liên lạc trong trò chơi. Và trong công việc của mình, cô ấy có thể áp dụng những gì cô ấy đã học được với tư cách là một giáo viên.

“Là một giáo viên, bạn… thức dậy và phát biểu trước đám đông mỗi ngày. Vì vậy, khả năng trò chuyện ngẫu hứng với mọi người là điều rất tự nhiên đối với tôi.”

Cô nói, đối phó với các cộng đồng trực tuyến để chống lại hành vi độc hại có thể được coi là giảng dạy theo nhiều cách, bởi vì nó không chỉ là trừng phạt mà còn là giáo dục, có thể được thực hiện theo nhiều cách. Ví dụ, trong buổi nói chuyện của mình, Hayes đã đề cập đến cách thưởng và giới hạn chúng cho những người không nhận được lệnh cấm trong một số trò chơi.

Một phần của vấn đề quản lý chất độc cũng nằm ở nhân lực. Hayes nói với chúng tôi: “Việc kiểm duyệt và hỗ trợ khách hàng chứng kiến một trong những doanh thu cao nhất trong ngành vì họ phải đối mặt với ngôn ngữ tục tĩu và các mối đe dọa khủng khiếp hàng ngày”. “Và tâm lý con người chỉ có thể chịu đựng được điều đó trước khi hỏi liệu nó có xứng đáng hay không.”

Ngoài ra, cô ấy nói thêm, rất nhiều nhóm hỗ trợ đang “ở dưới cùng của cột vật tổ.” Nhiều người cố gắng tham gia vào ngành này theo cách này nhưng “sau đó họ có ấn tượng xấu về ngành công nghiệp game nói chung.”

“Và lương của họ không cao. Thực sự là không, đặc biệt là so với những công việc khác trong cùng công ty. Và thế là mọi người bắt đầu nghĩ, ‘Được rồi, tôi cần phải đọc ‘tự sát’ bao nhiêu lần trước khi tôi cần nghỉ việc.” công việc này?'”

Vấn đề cụ thể này liên quan chặt chẽ với thực tế là nửa sau cuộc nói chuyện của Hayes, tập trung vào việc trình bày Safe Voice, công cụ đa nền tảng do Unity phát triển sử dụng máy học để quản lý mức độ độc hại trực tuyến bằng cách kết hợp phiên âm với phân tích âm sắc và giám sát toàn bộ môi trường. Công cụ này theo dõi những thứ như hành vi và phản hồi của người chơi, chẳng hạn như liệu một người chơi cụ thể có bị tắt tiếng bởi tất cả những người tham gia khác hay cách mọi người phản ứng với các hành vi cụ thể.

Safe Voice ra mắt ở phiên bản beta kín vào tháng 7 năm ngoái và gần đây đã bước vào giai đoạn beta mở. Nó được thiết kế để cung cấp chính xác những gì thường thiếu: ngữ cảnh, được báo cáo chi tiết và dễ phân tích cú pháp.

Hayes nói với chúng tôi: “Đó là công nghệ học máy tốt nhất”. “Đó là một cách bảo vệ mọi người, nhưng không chỉ bảo vệ người chơi mà còn bảo vệ người điều hành.”

Nhưng thông qua việc tự động hóa loại nhiệm vụ này, liệu có nguy cơ tiếp tục hiểu sai về bối cảnh, sắc thái, trò đùa hay không? Hayes giải thích với chúng tôi rằng đó là lĩnh vực mà Safe Voice đặc biệt mạnh mẽ và hiệu quả. Nhưng nó cũng hoàn toàn có thể tùy chỉnh để studio sử dụng nó có thể điều chỉnh nó cho phù hợp với những hành vi có thể được coi là chấp nhận được trong các cộng đồng cụ thể.

Hayes nói: “Ví dụ, các trò chơi đều có xếp hạng. “Vì vậy, nếu trò chơi dành cho Người trưởng thành hoặc 17+, những lời tục tĩu sẽ dễ hiểu hơn và chỉ là một phần của ngôn ngữ khái quát mà thậm chí không nhất thiết có nghĩa là độc hại.” Cô nói thêm, trong những trường hợp đó, “có thể việc sử dụng từ ‘chết tiệt’ hoặc ‘chết tiệt’ với một giọng điệu trung lập chỉ là một phần của nhịp điệu nói chuyện.”

“[Fully automated moderation] có thể xảy ra trong tương lai, nhưng một số hãng phim muốn có sự kiểm tra nào đó của con người và tôi cũng ủng hộ điều đó”

Hayes cũng không nghĩ rằng việc cho phép một số loại ngôn ngữ nhất định trong các cộng đồng cụ thể có nguy cơ khiến những người chơi mới tiềm năng xa lánh, bởi vì những người chơi đó “phải là người lớn và nên hiểu bối cảnh về cách những lời lẽ tục tĩu này đang được sử dụng, đặc biệt là trái ngược với một trò chơi.” như Roblox, nơi phần lớn người chơi là từ 7 đến 14.”

Nhưng chỉ tập trung vào ngôn ngữ và giọng điệu là chưa đủ và hệ thống cần phân biệt các sắc thái tinh tế hơn cũng như tính đến việc cùng một từ có thể có ý nghĩa khác nhau ở những vị trí khác nhau. Chúng tôi đã hỏi Hayes về điều này và thực tế là các ngôn ngữ như tiếng Bồ Đào Nha, tiếng Tây Ban Nha hoặc tất nhiên là tiếng Anh có thể được nói theo những cách khá khác nhau tùy thuộc vào vùng lãnh thổ. Có một số từ tiếng Anh hoàn toàn không được chấp nhận ở Mỹ nhưng lại được chấp nhận ở những nơi khác. Cô ấy đồng ý và một lần nữa chỉ vào phân tích âm sắc.

“Vấn đề không chỉ là những gì bạn nói và cách bạn nói, mặc dù đó là những yếu tố quan trọng, mà còn là sự tiếp nhận của người nghe hoặc những người chơi khác. Vì vậy, hãy hiểu xem bạn có bị xúc phạm bởi những gì tôi nói hay không, dựa trên giọng điệu của bạn, và có tính đến điều đó.”

Đó là điểm cộng lớn so với phiên âm tự động đơn giản, nơi mọi người có thể nói những điều có vẻ ổn nhưng trong ngữ cảnh có thể khá khó chịu. Và tất nhiên nó cũng có thể hoạt động theo hướng ngược lại.

Nhưng ngay cả với tất cả những công việc khó khăn do AI thực hiện, hệ thống vẫn cần sự can thiệp của con người để phân tích tất cả dữ liệu đã chọn, đánh giá dữ liệu đó và sau đó thực hiện hành động. Liệu chúng ta có bao giờ đạt đến điểm mà toàn bộ quá trình sẽ được tự động hóa không?

“Nó có thể xảy ra trong tương lai,” Hayes nói. “Chúng tôi rất muốn đến được một nơi như thế. Nhưng tôi nghĩ các hãng phim muốn có sự kiểm tra nào đó của con người và tôi cũng hoàn toàn ủng hộ điều đó.”